Un conducteur parisien passe en moyenne 65,8 heures dans les embouteillages par an, soit environ deux fois plus qu’un conducteur marseillais qui en passe en moyenne 29,3. Tels sont les chiffres publiés par INRIX, spécialiste des données pour le trafic routier, pour l’année 2016.

Et si demain, il était possible de se rendre à son lieu de travail sans un seul embouteillage ?

Une équipe de chercheurs de l’Université Nanyang à Singapour a en effet développé un nouvel algorithme, permettant de décongestionner le système routier, et ainsi minimiser le risque d’embouteillages.

Un algorithme basé sur la théorie des graphes

La théorie des graphes, kezako ? Petit rappel, pour celles et ceux qui sont fâchés avec les mathématiques.

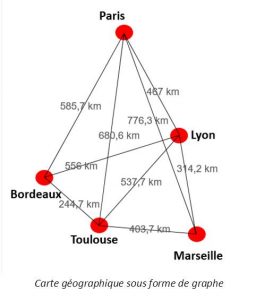

Un graphe, est tout simplement un ensemble de points (appelés sommets) reliés entre eux par des droites (appelées arêtes). Par exemple, on peut représenter une carte géographique sous forme de graphe : les sommets représentent les villes, et les arêtes, les routes menant d’une ville à l’autre. Sur chaque arête, on peut y définir un poids, par exemple le nombre de km entre deux villes, la vitesse d’une voiture, etc. La théorie des graphes est un algorithme permettant notamment de définir le chemin le plus court entre deux sommets (villes dans notre exemple), grâce au poids défini sur chaque arête. L’algorithme développé par les chercheurs se base sur la théorie des graphes, mais de façon plus élaborée.

Un graphe, est tout simplement un ensemble de points (appelés sommets) reliés entre eux par des droites (appelées arêtes). Par exemple, on peut représenter une carte géographique sous forme de graphe : les sommets représentent les villes, et les arêtes, les routes menant d’une ville à l’autre. Sur chaque arête, on peut y définir un poids, par exemple le nombre de km entre deux villes, la vitesse d’une voiture, etc. La théorie des graphes est un algorithme permettant notamment de définir le chemin le plus court entre deux sommets (villes dans notre exemple), grâce au poids défini sur chaque arête. L’algorithme développé par les chercheurs se base sur la théorie des graphes, mais de façon plus élaborée.

L’Intelligence Artificielle au service du réseau routier

Pour évaluer ces probabilités, les chercheurs ont au préalable déterminé les conditions favorables au risque d’embouteillages. Les résultats montrent que ces risques sont très liés au comportement humain des conducteurs. En effet, le ralentissement des automobilistes devant un accident, ou encore l’agressivité des conducteurs sous le stress des bouchons sont des facteurs favorisant les embouteillages.

Pour évaluer ces probabilités, les chercheurs ont au préalable déterminé les conditions favorables au risque d’embouteillages. Les résultats montrent que ces risques sont très liés au comportement humain des conducteurs. En effet, le ralentissement des automobilistes devant un accident, ou encore l’agressivité des conducteurs sous le stress des bouchons sont des facteurs favorisant les embouteillages.

L’idée générale du nouvel algorithme est d’adapter la vitesse des véhicules afin de réduire au maximum le risque d’embouteillages. Très vite, on se rend bien compte que cet algorithme est applicable uniquement aux voitures autonomes, puisque la vitesse des véhicules ne peut être adaptée automatiquement que sur des véhicules autonomes ! Et même, l’équipe de chercheurs précise que le bon fonctionnement de l’algorithme, nécessite qu’ «au moins 10% des véhicules soient connectés au réseau de l’intelligence artificielle ».

Une condition non négligeable à cet algorithme

Pour que l’algorithme développé par les chercheurs de l’Université de Nanyang ait un réel impact sur le flux routier, il faudrait que les voitures autonomes soient complètement démocratisées. Selon une étude de IHS Markit, à partir de 2035, il y aura au moins 21 millions de voitures autonomes vendues chaque année (ce nombre tendant à augmenter suivant les années). On est quand même loin du nombre de voitures vendues chaque année (90,68 millions en 2015 par exemple).

Pour que l’algorithme développé par les chercheurs de l’Université de Nanyang ait un réel impact sur le flux routier, il faudrait que les voitures autonomes soient complètement démocratisées. Selon une étude de IHS Markit, à partir de 2035, il y aura au moins 21 millions de voitures autonomes vendues chaque année (ce nombre tendant à augmenter suivant les années). On est quand même loin du nombre de voitures vendues chaque année (90,68 millions en 2015 par exemple).

Quoi qu’il en soit, cela ne semble pas freiner BMW, qui a déjà mis à disposition quelques-unes de ses données du parc automobile de Munich pour des tests en grandeur nature !

On peut toutefois largement penser que la démocratisation des véhicules autonomes se fera dans le futur, et que cet algorithme contribue à l’intelligence artificielle autours du trafic routier.

Par ailleurs, cet algorithme pourrait être complété par certaines données environnementales (comme l’indice de pollution, ou la quantité de C02 émise, etc.) pour obtenir à la fois le chemin le plus court, et le moins polluant possible !

Bonjour,

Merci pour cet article bien construit et explicatif, cette technologie est révolutionnaire.

Un tel changement de la conduite serait efficace sur certains tracs du quotidien (les embouteillages bien évidemment), mais il faut tout de même pondérer le discours car certes certains éléments seront éliminés mais le plaisir pourrait lui aussi disparaître ! Le plaisir même de conduire serait totalement amené à disparaître si nous remplaçons la conduite humaine par la conduite automatique !

L’intérêt d’acheter un véhicule disparaîtrait, alors est-ce que le gain de temps doit-il primer sur le plaisir ?